nomic-embed-text 是什么 - 下载安装及使用方法

nomic-embed-text 是一个用于文本嵌入(text embedding)和自然语言处理(NLP)的工具,通常用于将文本数据转换为高维向量表示。这些向量可以有效地用于机器学习、文本分析和其他NLP任务中,比如文本分类、相似度计算、聚类和语义搜索等。它结合了先进的嵌入技术,能快速有效地处理大规模文本数据,适用于各种语言处理任务。

嵌入(embedding)是一种将文本映射到固定维度的连续向量空间的技术,通过这种映射,可以将自然语言中的相似文本映射到向量空间中相近的点。因此,nomic-embed-text 在许多实际应用中具有广泛的前景,比如情感分析、语义搜索、自动问答系统等。

一、下载安装

nomic-embed-text 支持在大多数常见的操作系统上运行,包括 Windows、macOS 和 Linux。安装前,确保已经安装了 Python 和相关的依赖包管理工具(如 pip)。

安装 nomic-embed-text 非常简单,只需要使用 Python 包管理工具 pip 安装即可。以下是安装步骤:

- 安装 Python 环境

如果尚未安装 Python,请先从 Python 官网 下载并安装 Python。建议使用 Python 3.x 版本。 - 安装 pip

pip 是 Python 的包管理工具。如果已经安装了 Python,pip 通常会自动安装。如果没有安装 pip,可以参考官方文档安装 pip。 安装 nomic-embed-text 包

打开命令行终端,输入以下命令来安装:pip install nomic-embed-text该命令将自动从 PyPI(Python Package Index)下载并安装最新版本的 nomic-embed-text 包。

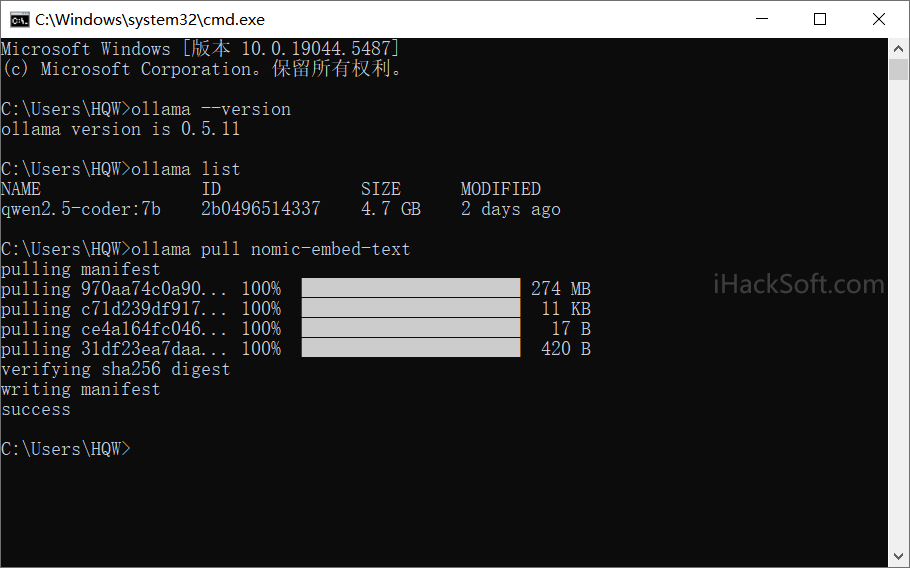

当然,你也可以通过 Ollama 安装 ,它是目前 Ollama 平台里最流行的 embedding 模型,安装非常简单,命令为:

ollama pull nomic-embed-text

二、使用方法

安装完成后,您可以开始在 Python 项目中使用 nomic-embed-text。以下是基本的使用示例:

1. 导入库

首先,在 Python 中导入 nomic-embed-text 库:

import nomic_embed_text2. 创建文本嵌入对象

接下来,您可以创建一个文本嵌入模型,通常需要加载一个预训练的模型来进行文本嵌入。具体的加载方法和模型路径会在文档中给出,以下是一个简单的例子:

embedder = nomic_embed_text.Embedder(model_name="default_model")在此示例中,"Embedder"类用于创建一个文本嵌入对象,"model_name"参数用于指定要使用的模型。您可以选择不同的模型,根据任务的不同需求来调整。

3. 文本嵌入

将文本转换为嵌入表示非常简单,您只需调用“embed”方法,将文本传递给模型:

text = "Nomic is a powerful tool for text embedding."

embedding = embedder.embed(text)

print(embedding)这段代码会将文本 "Nomic is a powerful tool for text embedding." 转换为高维向量,并输出结果。

4. 批量嵌入

如果您有多个文本需要嵌入,可以一次性传递一个文本列表。这样可以提高效率,尤其是在大规模数据集上运行时:

texts = [

"Nomic is a powerful tool for text embedding.",

"Text embedding is crucial for many NLP tasks.",

"This is an example of batch processing."

]

embeddings = embedder.embed_batch(texts)

for emb in embeddings:

print(emb)5. 使用嵌入进行相似度计算

文本嵌入最常见的应用之一是计算文本之间的相似度。嵌入向量的相似度可以通过计算向量之间的距离(例如余弦相似度)来实现。

from sklearn.metrics.pairwise import cosine_similarity

text1 = "Nomic is a powerful tool for text embedding."

text2 = "Text embedding is crucial for many NLP tasks."

embedding1 = embedder.embed(text1)

embedding2 = embedder.embed(text2)

similarity = cosine_similarity([embedding1], [embedding2])

print(f"Cosine similarity: {similarity[0][0]}")通过计算余弦相似度,您可以量化两个文本之间的相似性。

三、常见问题及解决方法

1. 模型加载失败

如果在加载模型时遇到错误,可能是由于模型文件不存在或路径不正确。确保所需的模型文件已正确下载,并且路径配置无误。

2. 内存不足

处理大量文本时,可能会遇到内存不足的问题。此时可以考虑分批处理文本或使用更小的模型进行嵌入。

3. 性能问题

在处理大量数据时,可以使用多线程或分布式计算来加速文本嵌入过程。此外,使用较小的嵌入维度和简化的模型也可以提高处理速度。

总的来说,nomic-embed-text 是一个功能强大且易于使用的文本嵌入工具,广泛应用于各种自然语言处理任务。通过简单的 Python API,用户可以轻松将文本转换为高维嵌入向量,并进行进一步的分析或应用。通过安装和使用该工具,用户能够提升文本数据处理的效率,并在不同的 NLP 任务中取得良好的效果。